A Meta anunciou hoje uma série de medidas e recursos visando combater a extorsão sexual no Instagram — crime que envolve chantagens financeiras relacionadas ao compartilhamento de imagens sensíveis da vítima sem autorização.

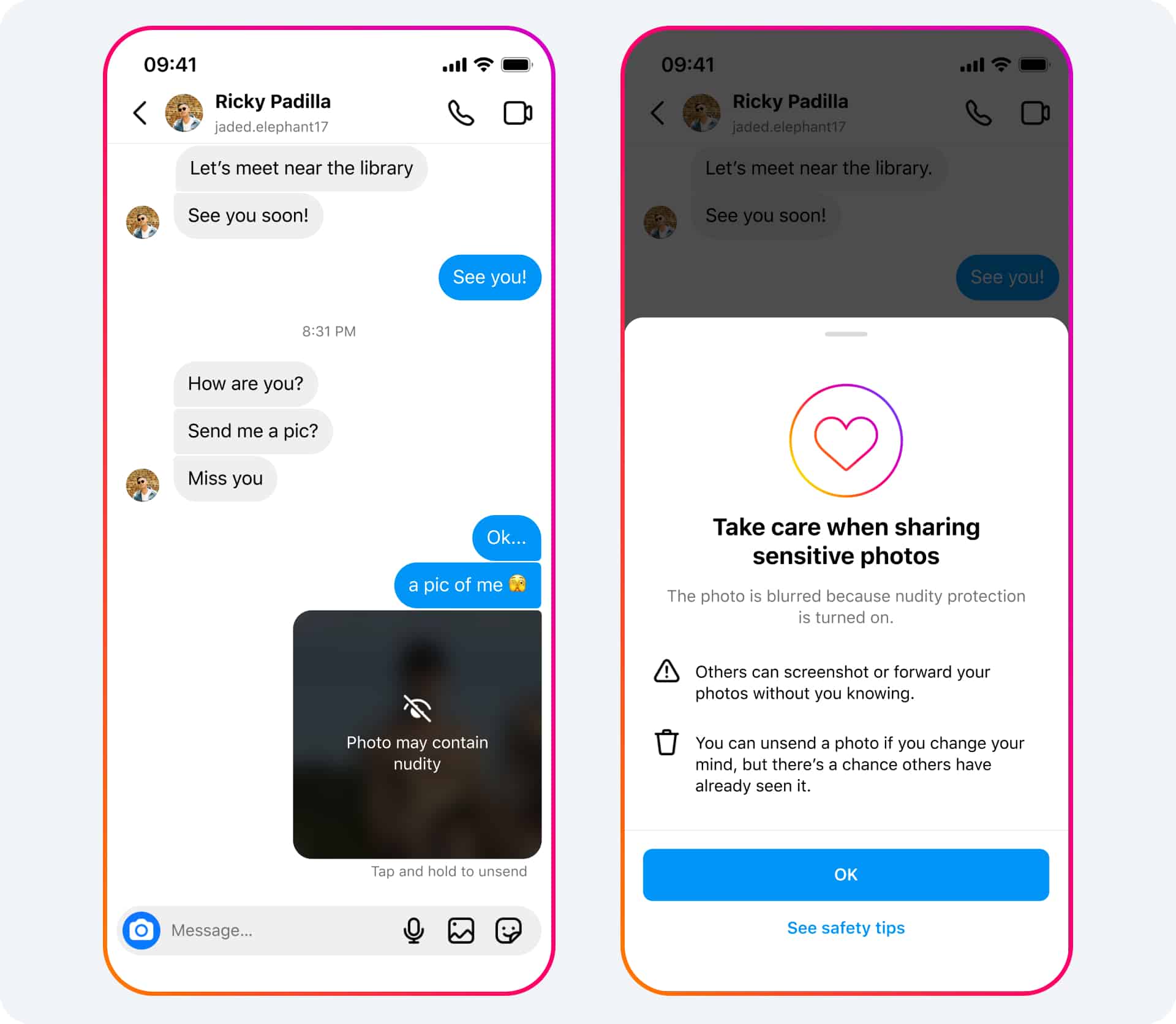

Como principal novidade nesse sentido, agora fotos com nudez enviadas na plataforma poderão ser automaticamente borradas — como parte de uma estratégia denominada Proteção Contra Nudez em DMs.

De acordo com a Meta, o app utilizará aprendizado de máquina para identificar se uma imagem enviada contém ou não nudez — o que permitirá realizar esse processo no dispositivo, sem que a empresa tenha acesso às imagens.

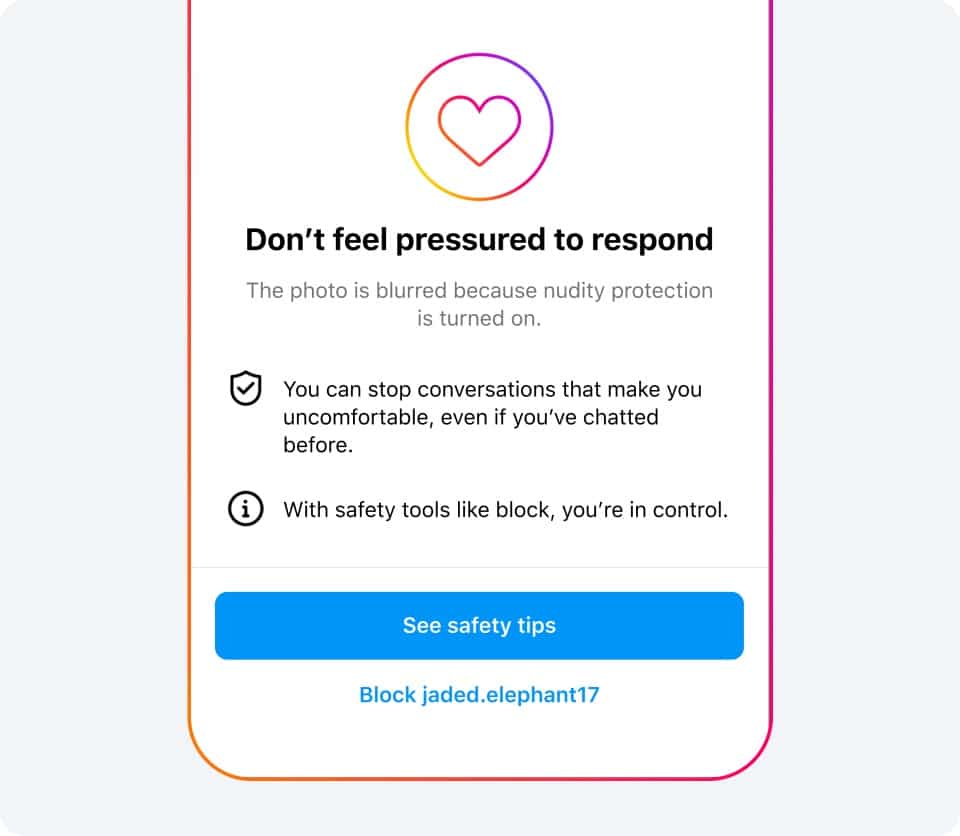

Além de desfocar as fotos recebidas, a empresa também alertará o usuário que ele não precisa responder ou visualizar — bem como sobre a opção para bloquear o remetente e encerrar o bate-papo.

Caso um usuário com a Proteção Contra Nudez ativada opte por enviar imagens contendo nudez, uma mensagem pedirá para que ele tenha cautela ao enviá-las, alertando-o que o envio pode ser cancelado a qualquer momento.

Essa proteção será ativada automaticamente para menores de 18 anos, mas o Instagram recomendará amplamente a sua ativação aos demais usuários, por meio de uma notificação.

O Instagram também tornará mais difícil para que golpistas entrem em contato com adolescentes, desenvolvendo tecnologias para identificar contas que estão potencialmente envolvidas em extorsão sexual.

Agora, mensagens dessas contas irão diretamente para a pasta de conversas ocultas e os donos desses perfis nem mesmo verão o botão para enviar mensagens no perfil de adolescentes hospedados na plataforma.

Medidas muito bem-vindas, não acham?