O “inferno congelou” no mundo da tecnologia quando a Apple anunciou, na semana passada, novos recursos de proteção contra abuso e pornografia infantil — os quais serão disponibilizados com o iOS/iPadOS 15 e o macOS Monterey 12 até o fim deste ano.

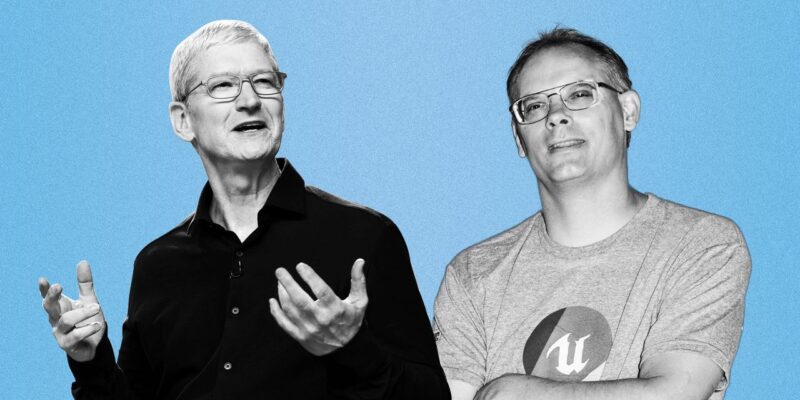

Mesmo que a Apple já tenha se posicionado e esclarecido como os prósperos recursos funcionarão, usuários, organizações e até empresas estão com os dois pés atrás — incluindo o CEO1Chief executive officer, ou diretor executivo. da Epic Games (a qual possui suas próprias desavenças com a Apple, é bom lembrar).

Acusações de Tim Sweeney

Apple e Epic não estão em bons termos há um bom tempo; entretanto, à parte dos seus próprios problemas, o chefão da gigante dos games, Tim Sweeney, decidiu comentar (ou melhor, criticar) os prósperos recursos de segurança da Maçã, insinuando que isso funcionará como uma forma de o governo “vigiar a população”.

Primeiramente, Sweeney afirma que a Apple usa “padrões obscuros” para ativar recurso como as Fotos do iCloud (por meio do qual o escaneamento de imagens funcionará), forçando as pessoas a “acumular dados indesejados”.

Aludindo ao julgamento antitruste da Epic contra a Apple e ao fato de que a Maçã deve cumprir todas as leis dos países onde possui negócios, Sweeney presume que “a Apple agora será um braço da vigilância estatal sempre que necessário” — em uma clara referência às negociações dela com o governo chinês.

Sweeney concluiu apontando que a ameaça em potencial dos novos recursos é “uma aliança profana entre o governo, os monopólios que controlam o discurso online e os dispositivos de todos, usando o disfarce de corporações privadas para contornar as proteções constitucionais”.

Vale notar que as acusações de Sweeney sobre o escaneamento de imagens (do iCloud) divergem um pouco sobre como o sistema realmente funcionará. Em vez de analisar a imagem em si, o recurso vai comparar hashes (pequenos códigos) e cruzar esses dados com um banco de dados de imagens com pornografia infantil.

Carta contra a implementação dos recursos

Para além de críticas, uma carta/petição online quer que a Apple suspenda os planos de lançar essas ferramentas de segurança — com signatários incluindo especialistas como Edward Snowden, cujas críticas espelham o que o CEO da Epic apontou.

A petição, que parece mais um documento de acusação do que uma carta aberta, detalha os recursos que a Apple anunciou e analisa a abordagem da empresa sobre o abuso e a pornografia infantil — razões pelas quais os recursos foram criados.

Embora a exploração infantil seja um problema sério e os esforços para combatê-la sejam quase inquestionavelmente bem-intencionados, a proposta da Apple apresenta uma backdoor que ameaça minar as proteções de privacidade fundamentais para todos os usuários de produtos Apple.

De acordo com uma reportagem do Los Angeles Times, a Apple afirmou que a implementação desses recursos *não* criará uma backdoor e nem quebrará a criptografia de ponta a ponta do app Mensagens, por exemplo.

A carta também menciona preocupações com a constante análise de hashes de imagens salvas no iCloud; no entanto, como destacado por John Gruber, do Daring Fireball, existe um “limite” de hashes que desencadeiam o escaneamento do sistema da Apple.

A Apple não está dizendo qual é esse número limite, mas, para fins de argumentação, vamos dizer que o limite é dez. Com dez ou menos correspondências, nada acontece e nada pode acontecer na extremidade da Apple. Somente após 11 alertas (limite + um) a Apple entrará em ação. Mesmo assim, alguém da Apple investigará, examinando o conteúdo dos vouchers de segurança que acompanharão cada foto do iCloud. Esses vouchers são criptografados de forma que só podem ser descriptografados no lado do servidor se o limite (mais um) de correspondências tiver sido identificado.

A carta pede que a Apple interrompa “imediatamente” a implantação de “sua proposta de tecnologia de monitoramento de conteúdo”, e que a empresa emita uma declaração “reafirmando seu compromisso com a criptografia de ponta a ponta e com a privacidade do usuário”.

É verdade que a Apple tem adotado uma abordagem com caráter impositivo, portanto é sempre válido questionar qual é (ou não) o melhor método para implantar recursos com tamanha importância. Como destacado por Alex Stamos, do observatório da Internet da Universidade de Stanford:

.

Na minha opinião, não existem respostas fáceis aqui. Encontro-me constantemente dividido entre o desejo de que todos tenham acesso à privacidade criptográfica e a realidade da escala e profundidade dos danos que foram possibilitados pelas tecnologias de comunicação modernas.

Opiniões diferenciadas sobre isso são ok.

Stamos defende o desenvolvimento de recursos para inibir os efeitos de crimes como o abuso a pornografia infantil, mas ressalta justamente a abordagem adotada pela Apple, colocando em cheque o nível de intrusão com o grau de eficácia que poderá apresentar.

Aos interessados, é possível conferir a análise completa do especialista aqui.

Notas de rodapé

- 1Chief executive officer, ou diretor executivo.